輝達(NVIDIA)推出第八代人工智慧(AI)軟體TensorRT 8,讓語言查詢的推論時間減半,並讓開發人員得以打造高效能搜尋引擎、廣告建議與聊天機器人,並能從雲端到邊緣提供相關服務。

TensorRT 8的優化只需要1.2毫秒就能在BERT-Large上達到破紀錄的語言應用速度,而BERT-Large是被廣泛使用的Transformer模型之一。企業以往只能縮小模型的大小,但也因此造成較低的精準度,如今有了TensorRT 8,企業可以把模型的大小擴增兩倍或三倍,並提升精準度。

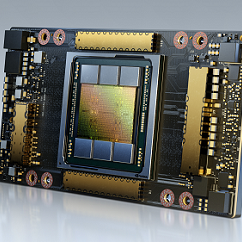

除了Transformer的優化,TensorRT 8還透過另外兩個關鍵功能達成AI推論的突破。稀疏性(Sparsity)是NVIDIA Ampere架構GPU中用以提升效率的效能技術,可以讓開發人員藉由減少運算作業以加速神經網路。

量化感知訓練讓開發人員可以在不犧牲精準度的情況下,運用已訓練好的模型和INT8的精度運行推論,這讓他們在Tensor核心上進行高效率推論時,可以減少運算與儲存的時間。

各產業的廠商紛紛採用TensorRT打造對話式AI與各種領域的深度學習推論應用。Hugging Face是全球各產業的AI服務供應商所仰賴的開源AI企業,該公司與NVIDIA密切合作,以導入能大規模執行文字分析、神經搜尋與對話式應用的開創性AI服務。

而提供醫療技術、診斷學及數位解決方案的GE Healthcare亦使用TensorRT協助加速超音波的電腦視覺應用。超音波是疾病初期檢測的重要工具,此應用可以讓臨床醫師透過該公司的智慧醫療照護解決方案,提供高品質的照護服務。