多感測融合已成為自動駕駛與智慧座艙不可或缺的核心技術,本次論壇集結國內外技術專家,從關鍵感測技術、車用運算平台、測試與驗證等角度, 剖析車用感測融合的實務開發策略。

在智慧車快速演進的浪潮中,多感測融合已成為自動駕駛與智慧座艙不可或缺的核心技術。隨著影像感測器、毫米波雷達、光達(LiDAR)、飛時測距(ToF)、超音波等多種感測器的大量導入,車輛不再依賴單一感知來源,而是透過多模態感測融合,建構出更精準、更安全的全方位環境感知能力。這樣的技術不僅是實現L2+至L3自動駕駛的關鍵,更是車輛能因應法規標準、保障乘員安全、強化駕駛體驗的必然趨勢。

對台灣廠商而言,多感測融合意味著從零組件與模組供應,進一步切入運算平台、AI演算法、車載高速網路等高附加價值領域,為產業升級與國際鏈結開啟全新契機。然而,多感測融合的實現並非易事,如何在效能、功耗、成本與可靠性之間取得平衡,是各大車廠與供應鏈共同面對的難題。

SDV時代的感測融合架構

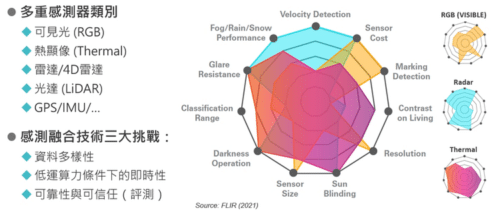

智慧車輛正從硬體驅動走向軟體定義(Software-Defined Vehicle, SDV),車輛功能透過軟體持續升級,感知能力更成為所有智慧駕駛與自動駕駛系統的核心。資策會軟體院移動安全信賴評測中心主任朱柏嘉(圖1)表示,車輛感知能力不再依賴單一傳感器,而是整合RGB可見光影像、熱成像、LiDAR、4D毫米波雷達、GPS/IMU等多源資料,彌補彼此在夜間、雨霧、距離與靜止物識別上的限制(圖2)。

軟體定義汽車時代,感測融合面臨三大難題:

- 資料多樣性不足:必須導入台灣真正的道路特性,例如夜雨、逆光、混合車流、褪色標線與大量機車等日常且複雜情境。

- 低算力設備即時辨識需求:多數大型車隊採用低畫質行車紀錄器,AI必須能在劣質影像上維持可靠度,並於可負擔的運算平台上運行。

- AI模型的可信任評測:隨歐盟AI法規與ISO 8800標準成形,車載AI必須具備可量測、可驗證的評測流程。資策會提出FAiTH評測工具,讓AI模型的準確率、延遲、場景涵蓋率與韌性都能標準化。

朱柏嘉認為,台灣雖非整車製造大國,但在半導體、AI、感測器、資料庫與嵌入式平台上具備完整供應鏈,正好切入智慧車感測的核心價值鏈。資策會也積極與車廠、晶片商、國際認證機構合作,目標在台建構AI評測能量,讓台灣成為智慧車感知技術的下一個國際輸出基地。

毫米波雷達感測邁向全天候/高解析

為了提升車輛的智慧化程度,感測器數量與品質的要求越來越高,德州儀器(TI)應用工程師王盈傑(圖3)認為,為達成L1~L2級自動駕駛及滿足NCAP要求,汽車雷達配置正朝(4+1)趨勢發展。應用範圍廣泛,涵蓋自動緊急煞車(AEB)、ACC等長距離預防碰撞功能,以及BSD、R-CTA等角雷達應用。

在77GHz ADAS雷達方面,王盈傑說明,TI新一代AWR2944P/AWR2E44P單晶片系列整合4Tx/4Rx收發器、C66x DSP和HWA 2.1硬體加速器,可提供更高的訊噪比(SNR)和角解析度。特別是第四個發射器(4th TX)的加入,能將角解析度提升33%,並能將目標物體分離度提升至4公分。支援1Gbps乙太網路介面,可在邊緣運算架構(Edge Architecture)中進行高階感測融合。對於更高解析度,TI亦提供利用級聯(Cascade)技術實現的成像雷達(如AWR2243),偵測範圍可達350公尺以上,角解析度小於1度。

針對車內(In-Cabin)應用和短距離感測,TI則推出60GHz低功耗解決方案,如AWRL1432/AWRL6432。雷達憑藉其高運動敏感度,能執行兒童存在偵測(CPD),包括呼吸所需的微小動作,不受光線或溫度影響。短距雷達也支援腳踢式尾門開啟(KTO)功能,提供超過95%準確度,並可取代傳統超音波感測器。

TI的毫米波雷達產品線為OEM 廠商提供從高性能到低成本、從車外到車內的全面且可擴展的解決方案,賦能次世代ADAS系統實現全方位高解析感測應用。

自駕車感測融合測試難題有解

感測融合需要整合更多感測器類型,以Waymo為例,L4/L5級自駕車的決策核心,是建立在多重感測器(Radar、LiDAR、Cameras)融合的數據之上。是德科技(Keysight)技術部門資深技術專案經理張式先(圖4)提到,車輛電腦必須分析所有感測器數據,才能做出轉向或煞車等正確反應。然而,單靠車載感測器無法解決所有問題,例如被遮擋的視線或車輛意圖的傳達,凸顯車聯網(V2X)技術的重要性。

V2X(Vehicle to Everything)通訊包括車對車(V2V)、車對基礎設施(V2I)和車對行人(V2P),是實現非視距(NLOS)感知、傳達行車意圖和提升態勢感知如盲區路口警示的關鍵。為此,自駕車的驗證必須從傳統的單純感測器測試,擴展到包含C-V2X通訊協議、功能和RF性能的複雜測試。Keysight的自主駕駛模擬平台(ADE)正是在實驗室環境中,透過硬體迴路(HIL)系統,整合模擬感測器與V2X訊號,向車輛決策演算法提供數據,以實現安全且可重複的測試。

傳統的雷達目標模擬器(RTS)僅能使用點目標模型(Point Target Model),將目標物體簡化為單一反射點,無法模擬物體的實際空間延伸、微都卜勒效應以及真實世界中常見的多重路徑反射(Multipath) 現象。為解決現實與測試脫節的難題,張式先說,Keysight 推出雷達場景模擬器(Radar Scene Emulator, RSE)。採用更先進的散射中心模型(Scattering Center Model), 將複雜物體模擬成多個離散的散射中心點。另外,RSE能夠在受控的實驗室環境中,重現因道路護欄、高架橋或地面反射而產生的鬼影目標(Ghost Targets)。這些鬼影往往是導致自駕車在實測中發生意外的邊緣情況(Edge Cases)。

建構高效/準確自駕數據閉環系統

自動駕駛開發流程中最耗時、也是最關鍵的一環,即是高效、準確地利用真實世界的資料,以持續改善和驗證感知與控制演算法。昆易電子車載產品線總經理葉周青(圖5)強調,L3級別以上的自動駕駛系統,其核心開發模式建立在數據閉環(Data Closed-Loop)之上。系統包含三大核心:數據採集、數據回灌、模擬閉環。

- 數據採集(Data Acquisition):透過車載平台採集真實行駛場景中的多感測器原始資料。

- 數據回灌(Data Replay):將採集到的原始資料在實驗室環境中,回放給ECU或域控制器。

- 模擬閉環(Simulation HIL):在硬體迴路(HIL)中,利用模擬場景軟體進行虛擬測試與驗證。

在數據採集端,隨著感測器種類增多及原始資料量暴增, 傳統工具已難以負荷。葉周青說,昆易的解決方案強調數據的同步性、精準度和整合性, 並提供高性能的記錄儀,能夠處理多路攝影機、高頻率雷達和LiDAR數據的同步採集, 並確保資料完整性和時間戳記(Timestamp)的精確對齊,也是後續演算法驗證的基礎。

實驗室測試加速器回灌與模擬HIL最能加速研發效率。葉周青說,昆易的系統能夠將真實路測的數據,透過高速介面精準地注入到待測的域控制器(Domain Controller)中,讓控制器認為正跑在路上,能安全、可重複地測試在實際環境中遇到的邊緣案例(Edge Cases),大幅提高測試效率。

模擬閉環則透過與模擬軟體的整合,昆易的即時機(Real- Time PC)能提供精準的車輛動力學模型和環境模擬,用於驗證感知、融合和規劃控制等核心演算法。特別是針對ADAS 功能的自動化腳本測試,有效減少對實車路試的依賴。

讓車輛看到世界並理解世界

智慧駕駛的三大核心——感測、決策、控制中,感測是基礎,而感測融合是提升感知準確度的關鍵。從早期單一影像處理到現在多模態感測器的即時、大規模融合,導致運算需求呈現指數級成長。L3級別以上的自駕車,其所需的總算力(TOPS)將數倍於L2+系統。

為有效分配和處理龐大的感測數據,芯鼎科技產品策劃執行部企劃總監郭俊德(圖6)提出了C-AR.AI的理念與多層次處理架構。

邊緣層(Edge Layer)強調感測器端或近感測器端的處理能力。芯鼎的VisionSource,內建神經網路處理單元(NPU)的智慧影像感測器模組。能預先在邊緣端處理和過濾原始影像數據,並輸出結構化、低延遲的資訊(如物體邊界框、語義分割),大幅減輕中央域控制器(Domain Controller)的負擔。

中央層(Central Layer)則採用異質運算架構(Heterogeneous Computing Architecture),郭俊德解釋,將CPU、GPU、NPU、DSP等不同類型的處理器整合在同一晶片上,各司其職, 實現算力的最佳化與高能效比。

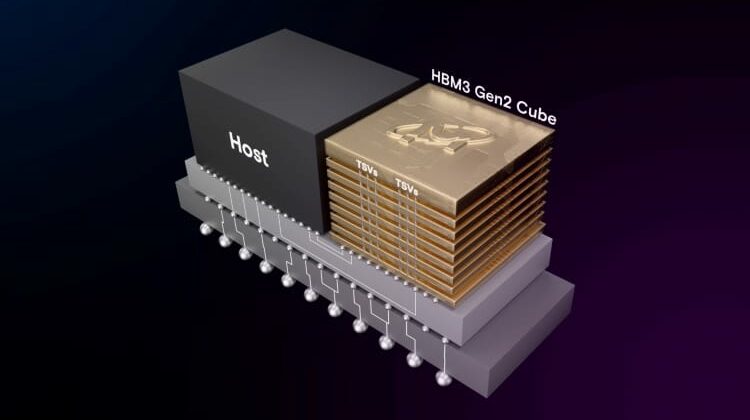

低功耗與可擴充性是未來,郭俊德進一步說明,未來的車載晶片競爭,將不再是單純比拼算力,而是強調如何更省電、更聰明、更具擴充性的運用算力。低功耗AI晶片和小晶片(Chiplet)架構將成為主導。透過感測融合讓車輛看到世界,再透過高效算力讓車輛理解世界,是實現智慧駕駛的兩大支柱。