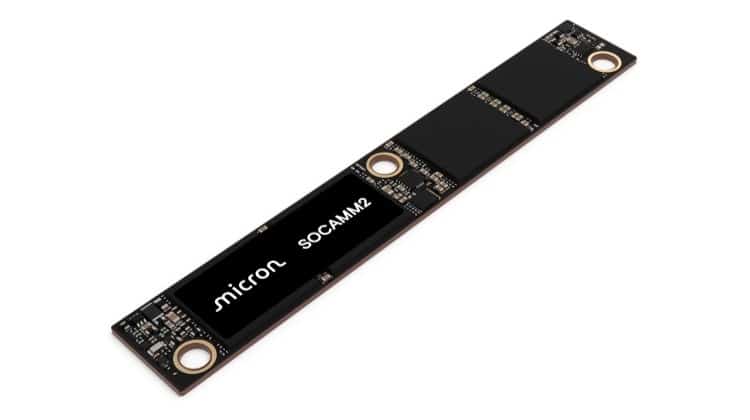

美光科技(Micron)宣布,該公司已正式開始向客戶提供256GB SOCAMM2模組的樣品,進一步鞏固其在低功耗伺服器記憶體領域的領先地位。此一里程碑由業界首款32Gb LPDDR5X單晶粒設計推動,為AI資料中心帶來變革性的重大突破,提供足以實現全新系統架構的低功耗記憶體容量。

AI訓練、推論、代理式AI與通用運算的融合,正推動更嚴苛的記憶體需求,並重塑資料中心的系統架構。現代AI工作負載推動大型模型參數、龐大的上下文視窗及持久性關鍵價值(KV)快取的需求,而核心運算則持續在資料密集度、並行處理和記憶體使用量方面不斷攀升。

面對上述工作負載,記憶體容量、頻寬效率、延遲表現和能源效率已成為系統層級的主要瓶頸,直接影響效能、可擴充性和總體擁有成本。LPDRAM憑藉上述特性的獨特優勢,使其在日益受限於功耗與散熱條件的資料中心環境中,成為AI及核心運算伺服器的關鍵解決方案。 美光正與NVIDIA攜手合作,共同設計先進記憶體解決方案,以滿足先進AI基礎架構的需求。

美光雲端記憶體業務部門資深副總裁暨總經理Raj Narasimhan表示,該公司的256GB SOCAMM2可為AI與高效能運算提供最具能源效率的CPU附加記憶體解決方案。該產品是目前業界容量最高、功耗最低、規格尺寸最小的模組化記憶體解決方案,充分展現美光在技術與封裝領域的領先地位。

專為容量、能源效率和工作負載效能最佳化而設計

美光的256GB SOCAMM2為各種AI及通用運算工作負載提供更高的記憶體容量、大幅降低的功耗以及更快的效能表現。

在容量、功耗與尺寸方面,其容量較前一代192GB SOCAMM2提升三分之一,可為每顆8通道CPU提供2TB的LPDRAM,適用於更大的上下文視窗和複雜的推論工作負載。同時,256GB SOCAMM2的功耗更低,尺寸也更小,其功耗僅為同級RDIMM的三分之一,尺寸亦僅有三分之一,可有效提升機架密度並降低總體擁有成本。

在效能方面,在整合記憶體架構中,與現有的解決方案相比,256GB SOCAMM2用於KV快取卸載時,可將長上下文即時LLM推論中首個token的生成時間提升2.3倍。在獨立CPU應用中,LPDRAM每瓦效能比主流記憶體模組高出3倍以上,適用於高效能運算工作負載。

同時,模組化設計也大幅提升了系統的可維護性和可擴充性。模組化SOCAMM2設計可提升可維護性,支援液冷式伺服器架構,並可隨著AI和核心運算記憶體需求持續成長,實現未來容量擴充。

NVIDIA資料中心CPU產品部門主管Ian Finder表示,先進AI基礎架構需要在每個層面進行極緻的最佳化,才能有效應對高要求AI推論工作負載對效能與效率的需求。美光透過256GB SOCAMM2,以低於傳統伺服器記憶體的功耗,實現大規模記憶體容量與頻寬的卓越成就,為次世代AI CPU提供關鍵助力。